Uso Militar da IA em Debate

O uso militar da IA tem gerado discussões acaloradas, especialmente em relação à Anthropic, a empresa responsável pelo assistente de inteligência artificial Claude. Recentemente, a Anthropic voltou a dialogar com o governo dos Estados Unidos sobre como suas tecnologias podem ser empregadas em contextos militares. Este diálogo foi retomado após um período de estagnação, onde as partes não conseguiam chegar a um consenso sobre as aplicações de suas ferramentas.

A Anthropic expressou sua preocupação em não permitir que suas inovações sejam utilizadas para vigilância em massa ou para desenvolver sistemas de armamento autônomos. Por outro lado, o governo americano defende que as tecnologias devem ser aplicadas em qualquer situação que seja considerada ‘lícita’. Essa divergência de visões cria um cenário complexo para a colaboração entre a Anthropic e as Forças Armadas dos EUA.

Implicações do Acordo

O impasse anterior levou o presidente dos Estados Unidos a determinar que as agências federais suspendessem o uso dos programas de IA da Anthropic. O secretário de Guerra, Pete Hegseth, chegou a ameaçar classificar a empresa como um risco para a cadeia de fornecimento, o que poderia resultar em cortes de laços entre a Anthropic e empresas do setor militar.

Apesar dessa ordem, houve relatos de que o assistente Claude foi utilizado em operações militares, como na ofensiva contra o Irã. Isso levanta questões sobre a eficácia das restrições impostas e a necessidade de um acordo formal que permita um uso mais amplo das ferramentas da Anthropic.

Possíveis Resultados do Diálogo

Com a retomada das conversas, há a possibilidade de que um acordo seja alcançado, permitindo que os militares americanos utilizem os modelos de IA da Anthropic de forma mais abrangente. Isso não apenas beneficiaria as operações militares, mas também reduziria o risco de a Anthropic ser considerada uma ameaça à segurança nacional.

Além disso, essa situação pode impactar outras empresas de tecnologia, como a OpenAI, que também estão envolvidas em acordos com o governo para o uso de suas tecnologias de IA. A OpenAI, que desenvolve o ChatGPT, já anunciou um acordo que permite o uso de seus modelos pelo Pentágono, o que pode influenciar a dinâmica do mercado de IA militar.

O Papel da Anthropic no Setor de IA

A Anthropic é uma das principais empresas no desenvolvimento de inteligência artificial, com uma avaliação de mercado que atinge US$ 380 bilhões. A empresa foi pioneira ao assinar um contrato com o governo dos EUA para a utilização de suas tecnologias em contextos militares, um acordo que foi firmado em julho e que envolveu um investimento de US$ 200 milhões.

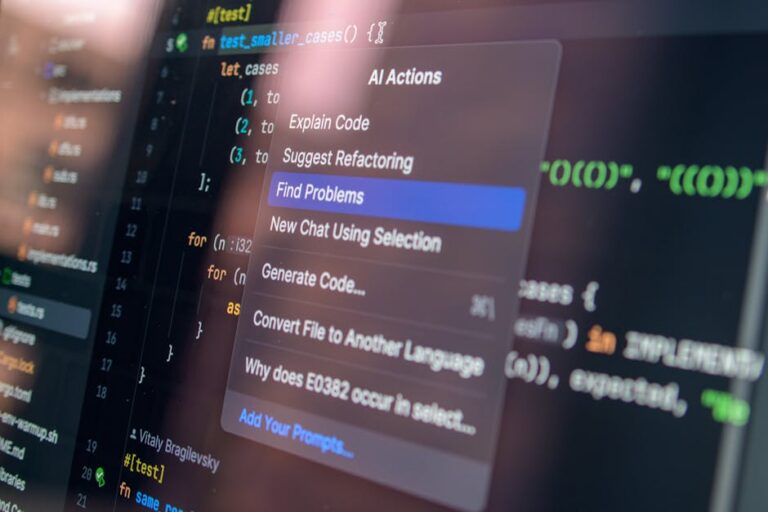

Esse contrato não apenas posicionou a Anthropic como uma líder no setor, mas também abriu portas para outras empresas, como o Google, que seguem o mesmo caminho. A crescente demanda por tecnologias de IA no setor militar levanta questões éticas e de segurança que precisam ser cuidadosamente consideradas.

Perguntas Frequentes

Quais são as preocupações da Anthropic sobre o uso militar de sua IA?

A Anthropic se opõe ao uso de suas tecnologias para vigilância em massa e armamentos autônomos.

Como o governo dos EUA pretende utilizar a IA da Anthropic?

O governo deseja usar a IA para qualquer finalidade que considere ‘lícita’, o que inclui operações militares.

Qual é o impacto da suspensão do uso da IA da Anthropic?

A suspensão pode afetar as operações militares e a colaboração entre a Anthropic e o governo dos EUA.

- Vigilância em massa

- Armamentos autônomos

- Colaboração militar

- Desenvolvimento ético de IA

Para mais informações sobre o uso de IA em contextos militares, você pode visitar o site do Departamento de Defesa dos EUA. Para acompanhar mais sobre tecnologia e inovação, acesse Em Foco Hoje.